Nuevo neutral light rig para look-dev

Tenemos un nuevo neutral light rig para look-dev, especialmente diseñado para personajes, aunque puede ser utilizado para todo tipo de assets. También hemos actualizado nuestro neutral light rig original para que funcione "out of the box" con las últimas versiones de Maya y Arnold.

Si ya habías comprado el light rig original, ponte en contacto con nosotros y te haremos llegar de forma gratuita la nueva actualización. Los suscriptores de elephant vfx pro, podéis acceder gratuitamente a uno de los dos neutral light rigs. Escribidnos si estáis interesados y os lo enviaremos.

Podéis acceder a ellos desde la página de assets.

IBL neutral light rig 01

IBL neutral light rig 02

En este video os explico como utilizar los rigs.

Curso "On-set supervision" en Campus i12

Vista de la biblioteca de la Universidad

Durante el mes pasado, he estado impartiendo clases en Jönköping University - Campus i12 en el Undergraduate Programme of Visual Effects (120 credits). Concretamente he estado trabajando en el curso "Supervisión en set de rodaje para VFX" (9 credits). Los organizadores y profesores del curso hemos sido, Philip Maddock (Prime Focus, The Mill) Misho Ristov (Framestore, Dneg, ILM), Xuan Prada (MPC, Dneg, Framestore) y Sofia Delis (Campus i12 programme manager).

Durante un mes y a semanas alternas, los profesores hemos tratado diferentes tópicos a considerar cuando se supervisa un proyecto audiovisual en set de rodaje y que requiere efectos visuales. Las clases se han alternado con prácticas por parte de los alumnos, los cuales debían completar un proyecto propio realizado en grupo por un conjunto de estudiantes de 3D y de 2D, el cual incluye trabajo en set de rodaje, procesado del material recogido, creación de contenido 3D, composición, color grading y delivery. En resumen, un proyecto de efectos visuales completo, pasando por todas las etapas más comunes hasta presentar el producto final.

El único criterio impuesto por el profesorado a la hora de realizar el proyecto, es que tenía que cumplir con las características de lo que denominamos "Tiny VFX". Estos son algunos de los ejemplos que pusimos a disposición de los diferentes grupos de alumnos.

Resultados previstos del aprendizaje

Una vez terminado el curso, los estudiantes deberían

- Demostrar los conocimientos claves a la hora de capturar survey data de un set de rodaje

- Ser capaces de juzgar que tipo de survey data es necesario para cada plano y los procesos a desarrollar para capturar cada tipo de dato relevante

- Procesar los datos recogidos para ser utilizados en un pipeline de VFX (data ingestion)

- Utilizar los datos recogidos para la creación de assets y planos foto realistas

- Ser capaces de realizar un proyecto de efectos visuales de principio a fin utilizando todo lo explicado en el curso

Contenido del curso

Tópicos generales del curso, desarrollados en profundidad durante las clases

- El entorno de producción cinematográfico

- Roles y responsabilidades en un set de cine

- Preparación de data sheets y shooting templates

- Captura de información de cámara y lente

- Captura de información para tracking y matchmoving

- Proceso profesional de captura de lens grids

- Spherical lenses

- Anamorphic lenses

- Primes

- Zooms

- Green screen / blue screen

- Captura de información para look-dev

- HDRIs

- Tipos de setups / assets

- Material samples

- Captura de información para lighting

- HDRIs

- Iluminación espacial

- Captura de información para la creación de assets digitales

- Modelado

- Fotografias

- Photogrammetry

- Mephisto scanning

- Texturizado

- Cross polarization

- Photogrammetry

- Actores digitales

- Modelado

- Mapas, bocetos e información de volumen y espacio

- Photogrammetry

- Lidar scanning

Una de las clases en Campus i12

Asignación de trabajo en grupo

El proyecto asignado se basa en el criterio "Tiny VFX". El paradigma principal consiste en un shooting correspondiente a un area muy pequeña donde haya que integrar assets digitales. El objetivo final consiste en realizar una integración de no más de 30 segundos, donde siempre prime la calidad por encima de la cantidad.

En grupos de 10 personas (3D + 2D) los alumnos deben desarrollar una idea con cierto énfasis narrativo, pero donde predomine lo visual. Con la idea concebida, deben presentarse las propuestas apoyándose en synopsis, bocetos y storyboards. Un styleframe/moodboard para vender la idea será considerado como opcional. Se deben valorar los aspectos artísticos y técnicos involucrados en el desarrollo del proyecto.

Requisitos indispensables

- El escenario donde se desarrolle la acción, ha de ser live footage y no ocupar una porción de más de 2x2 metros cuadrados

- Todos los planos han de estar compuestos por elementos live y elementos 3D como mínimo. No full cg shots

- Tiene que existir algún tipo de animación

- La duración completa de la pieza no excederá en ningún momento los 30 segundos, y como mínimo ha de contener entre 2 y 4 planos

- Estilo abierto

Entrega

- Delivery final en Quicktime full HD

- Visual breakdown

- Breakdown escrito

- Behind the scenes

Equipo y software

Los alumnos contarán con equipo de trabajo estandard, incluyendo cámaras de cine digitales, DSLRs, trípodes, shooting boards, luces, platós y green screens, etc. Del mismo modo, los alumnos tendrán acceso al software más común de la industria, incluyendo software de producción y gestión de tareas.

¿Quieres saber más sobre este curso, o realizar uno similar en tu universidad? Ponte en contacto conmigo para conocer todos los detalles.

"Robar" movimiento de cámara en Nuke

Tendemos a generar movimientos de cámara ficticios para nuestros shots estáticos, bien sea utilizando camera shakes u otros nodos procedurales. Puede que no sea una mala idea para algunas situaciones, pero siempre conseguiremos resultados más realistas utilizando movimiento de cámara real, no procedural.

En Nuke, existe una forma muy sencilla de "robar" el movimiento de cámara de cualquier plano y añadirlo a un plano estático, para crear un movimiento de cámara fluido, orgánico y natural. En este video te explico como hacerlo.

Los suscriptores de elephant vfx pro, podéis descargaros el footage de ejemplo para practicar.

Mip-Mapping

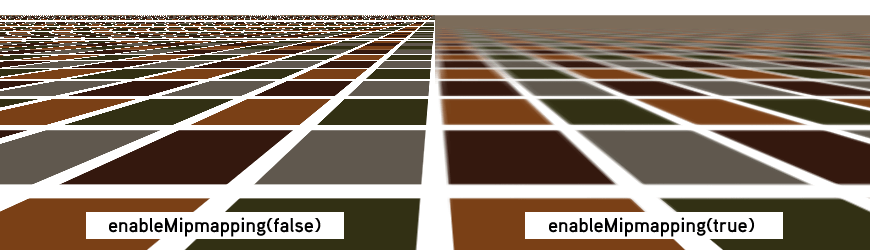

A estas alturas no creo que haya nadie que no esté familiarizado con mip-mapping, en cuanto a texturas se refiere, especialmente aquellos involucrados en los cursos de elephant vfx, donde siempre ponemos especial hincapié en tópicos como este. Aun así, siempre me encuentro con algunos estudiantes, que no conocen que es esto del mip-mapping, así que vamos a tratar de explicarlo de forma breve.

Para empezar, siempre, absolutamente siempre tus texturas tienen que pasar por un proceso de mip-mapping una vez están terminadas, si no, lo estas haciendo mal. Quizás te preguntes por que tus renders tardan mucho tiempo, especialmente mucho tiempo en arrancar, seguramente sea por culpa del mip-mapping, o mejor dicho, la ausencia del mismo.

Una escena mas o menos compleja, cuando hablamos de cine, contiene seguramente miles de texturas. Un hero asset puede contener por si solo miles de texturas agrupadas en decenas de channels. Como podéis imaginar, resulta imposible para el hardware y software que utilizamos, cargar semejante cantidad de información en memoria. Las texturas son generalmente de 8k 16 y 32 bits y como digo, se cuentan por centenares. Con el mip-mapping, conseguiremos agilizar la carga en memoria de toda esa información de una forma considerable, con lo que nuestros renders tardarán mucho menos en empezar, muchísimo.

El mip-mapping se originó para ayudar a mejorar el filtrado de las texturas, el antialiasing. Cuando los objetos se alejan de cámara, los detalles de superficie generalmente parpadean, flickean. El mip-mapping ayudará a solventar esta situación, ya que se crean resoluciones de textura acorde con la posición del objeto respecto a cámara.

Como decía antes, el mip-mapping nos ayudará a mejorar la carga en memoria de las texturas. Si un objeto tiene una textura de 4k pero en un determinado plano solamente ocupa 100 pixels en pantalla, no hay necesidad de cargar una textura de 4k, podemos cargar una versión de 128 pixels.

Esta generación de versiones de textura, puede hacerse al vuelo, o puede planificarse con anterioridad, antes de lanzar el render. Ahorrando mucho tiempo, tanto de carga en memoria, como de generación de versiones de texturas.

Todo esto relacionado con mip-mapping es render agnostic, no importa que motor de render utilices, debes de generar mip-mapped textures con todos. Generalmente los motores de render incluyen una utilidad para poder generar las texturas, mediante linea de comando o mediante interface gráfico.

En el caso de Arnold Render, en el menú Arnold -> utilities encontrarás una herramienta llamada TX manager, donde podrás fácilmente convertir tus texturas a .tx

El comando por defecto que lanza esta utilidad es "maketx -v -u --oiio" forzando las texturas a generar tiles optimizados para OpenImageIO 64x64 Si la textura fuera un color, la convertiría a un tamaño diminuto, de la misma forma que hace Mari cuando exportas colores planos.

Existen varios comandos que puedes utilizar durante la conversión, como el tipo de filtrado, el tamaño de tile, o la linearización de texturas. Yo personalmente lo dejo por defecto, ya que siempre trabajo de forma linear, es decir, las texturas no necesitan conversión cuando llegan al software 3D, ya salen linearizadas de Mari. Tienes mas información sobre maketx aquí.

En las opciones de render de Arnold, existe un apartado específico para las texturas, estas son las opciones mas importantes.

- Auto-convert Textures to TX: Esta opción convertirá de forma automática las texturas que existan en tu escena y no estén en formato .tx Personalmente no lo recomiendo, por el simple hecho de acostumbrarse al proceso de terminar las texturas y convertirlas manualmente a .tx antes de meterlas en el software 3D.

- Accept Unmipped: Con esta opción activada, podrás utilizar texturas que no hayan pasado por mip-mapping. Nunca lo utilices, tus renders tardarán una eternidad.

- Tile size: Tamaño de los tiles cuando los calcules de forma automática. Cuanto mas grande, menos cargas, pero mayor tiempo de carga.

- Max Cache Size (MB): Memoria destinada a la carga de texturas.

- Mip-Mapping Bias: Controla el nivel de mip-mapping. De forma individualizada por textura. Cuanto mayor numero, menor calidad de carga. Valores negativos cargaran texturas mas grandes.

Neutralización de referencias fotográficas

En este vídeo muestro como neutralizar referencias fotográficas para mantener la consistencia entre imágenes fotografiadas en set. A diferencia de como muestro en algunos de mis cursos, en esta ocasión no utilizo Nuke, si no que, utilizo Adobe Lightroom, ya que en muchas ocasiones no dispondras de Nuke en un set de cine.

También anuncio un nuevo proyecto formativo que me estoy planteando para elephant vfx.

Marvelous Designer -> Maya

Este vídeo complementa al que ya publicara tiempo atrás, donde mostraba el worflow Marvelous Designer -> 3D Max. En esta ocasión, muestro el mismo workflow utilizando Marvelous Designer y Maya, que es la opción mas común que encontrarás en un facility de VFX.